从推理到智能体:LLM强化学习中的信用分配,到底难在哪?

你有没有碰到过这种情况:用GRPO训练一个做数学推理的模型,效果还不错,但拿同一套方法去训一个写代码修bug的智能体,reward曲线死活不动?不是你调参的问题,是信用分配这件事,从推理到智能体,发生了质变。

这篇由独立研究员Chenchen Zhang撰写的综述,系统梳理了2024年至2026年初47种信用分配方法(41种核心方法+6种邻近使能方法),按"分配粒度"和"方法论"两个维度建立分类体系,并明确指出:推理RL的信用分配正在走向成熟,而智能体RL正在催生全新的方法范式——事后反事实分析、特权非对称评判器、轮次级MDP重构——这些在推理RL中找不到先例。

核心摘要

GRPO把一个episode的总reward均摊给每个token,短链推理还凑合,长链推理和智能体交互就彻底失灵。这篇综述覆盖47种方法,核心判断是:推理CA围绕PRM和无评判器群组比较已经趋于成熟,智能体CA则正在开辟全新战场——后见之明反事实分析、特权评判器、轮次级MDP是三个最有前景的方向。实验数据也印证了这一点:智能体场景下CA方法的增益均值(+8.5)高于推理场景(+6.0),说明episode-level信用在长轨迹上退化更严重。

论文信息

- 标题:From Reasoning to Agentic: Credit Assignment in Reinforcement Learning for Large Language Models

- 作者:Chenchen Zhang(独立研究员)

- 链接:https://arxiv.org/abs/2604.09459

- GitHub:https://github.com/xxzcc/Awesome-Credit-Assignment-in-LLM-RL

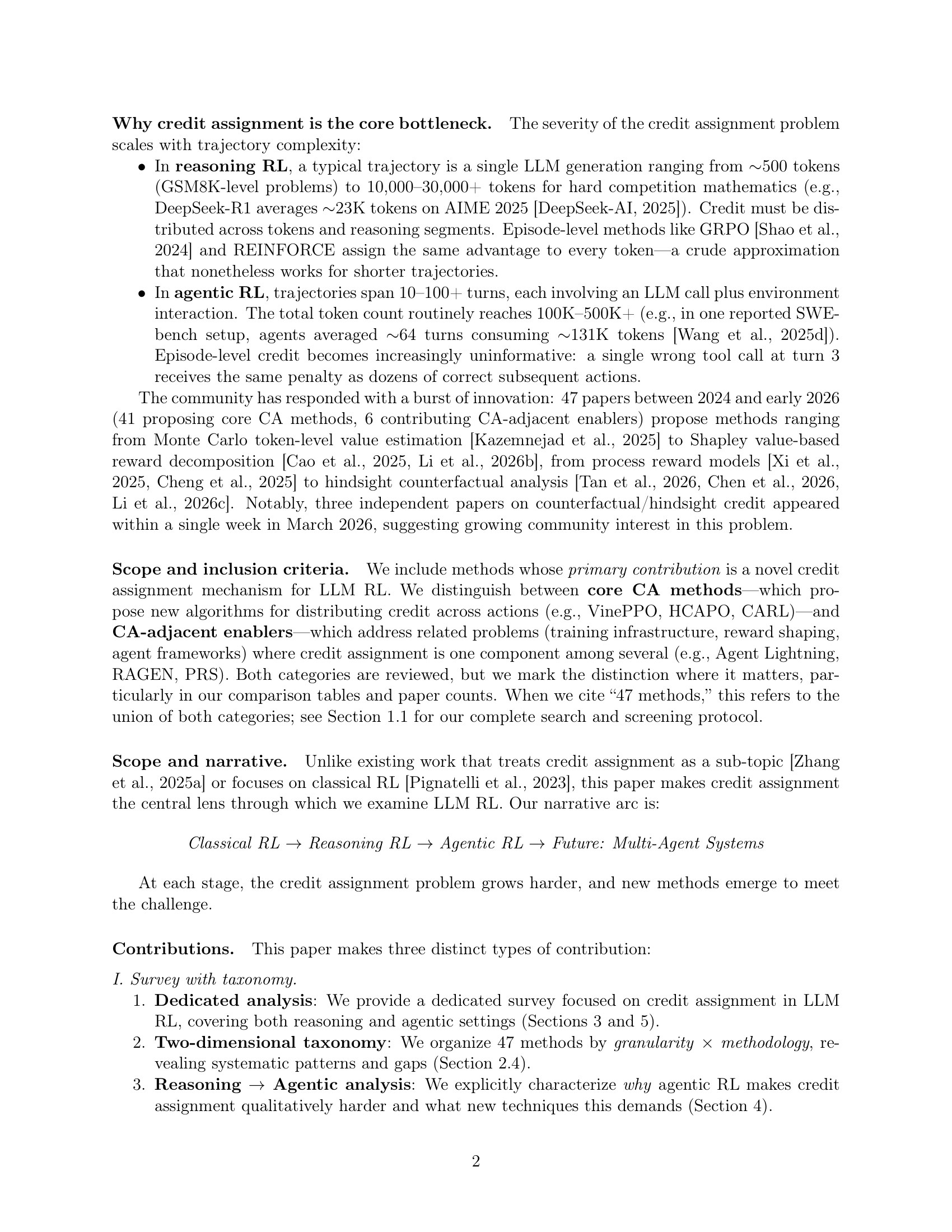

图1:从RLHF到推理RL再到智能体RL,轨迹越来越长,信用分配难度发生质的飞跃

问题在哪:GRPO的均摊信用为什么不work

先说清楚核心问题。GRPO的优势估计长这样:

一个trajectory \(\tau_i\) 里所有token共享同一个advantage值。推理RL中轨迹短(500-30K tokens,1轮),这种方法虽然粗暴但还能用——关键决策点少,信噪比勉强够。

但到了智能体RL,情况就完全不同了。论文给了一组对比数据:

| 设置 | 回合数 | Token数 | 决策点 |

|---|---|---|---|

| 推理RL (GSM8K) | 1 | 200-800 | 3-10步 |

| 推理RL (MATH) | 1 | 1,000-5,000 | 5-20步 |

| 推理RL (AIME) | 1 | 10,000-30,000+ | 20-100步 |

| 智能体RL (ALFWorld) | 5-20 | 5,000-30,000 | 5-20轮 |

| 智能体RL (WebArena) | 10-30 | 30,000-100,000 | 10-30轮 |

| 智能体RL (SWE-bench) | 20-100+ | 100,000-500,000+ | 20-100+轮 |

| 智能体RL (OSWorld) | 50-100 | 200,000-1,000,000 | 50-100+轮 |

从GSM8K的3个决策点到SWE-bench的100+个决策点,REINFORCE估计器的方差和决策点数量T成正比——\(\mathcal{O}(T \cdot \text{Var}[R])\)。T从10涨到100,方差涨10倍,信噪比直接崩溃。

RAGEN的工作把这个现象叫做"Echo Trap":episode-level信用下,梯度信号太吵,模型分不清有用的探索和无意义的重复,于是收敛到反复调用同一个工具的死循环里。

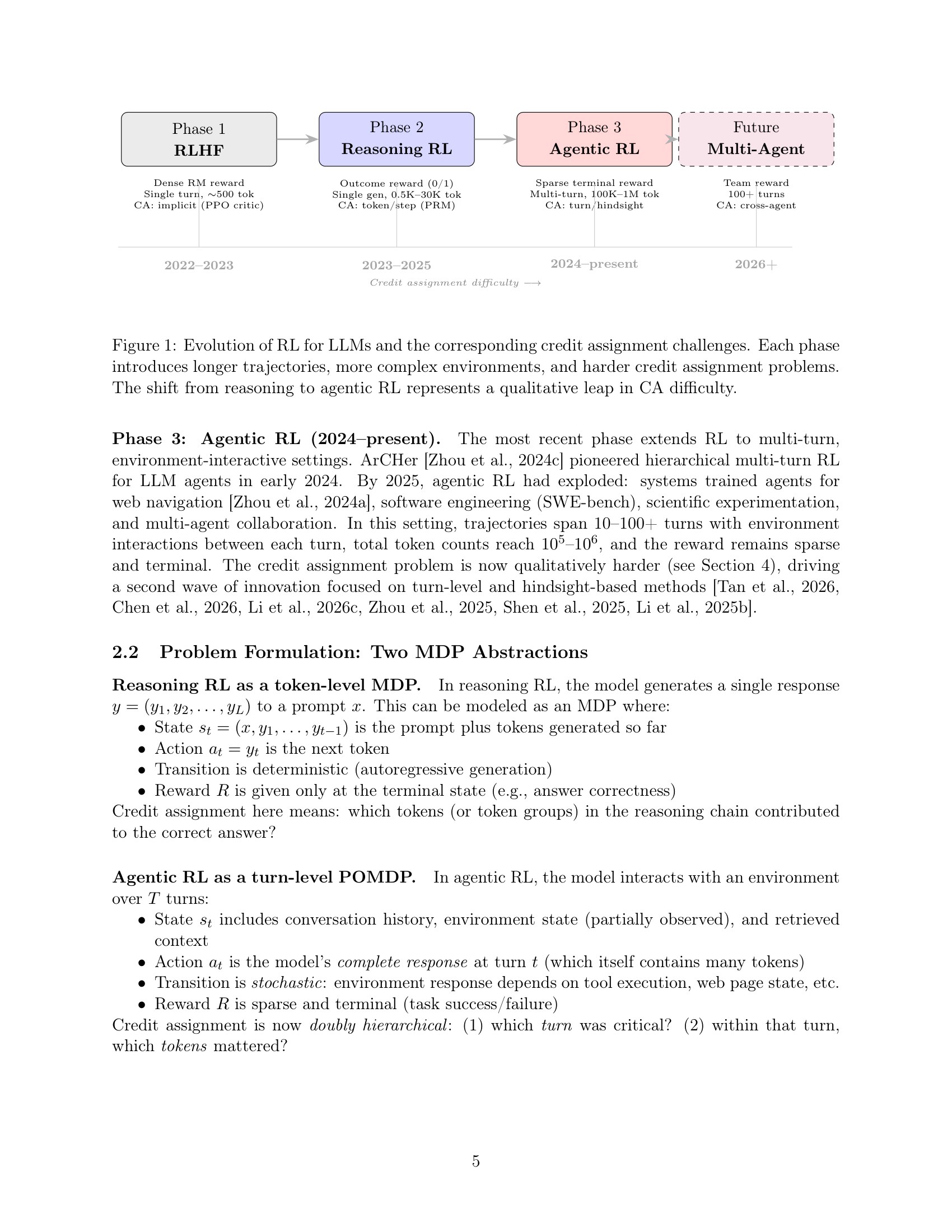

二维分类法:粒度 × 方法论

论文提出了一个清晰的二维分类框架:

- 粒度轴:Token → 片段 → 步骤/轮次 → 多智能体

- 方法论轴:蒙特卡洛 → 时序差分 → LLM评判器 → 博弈论 → 信息论

把47种方法铺到这个网格里,能看到一个明显的趋势:推理RL的方法集中在左上方(细粒度+MC/TD),智能体RL的方法集中在右下方(粗粒度+博弈论/信息论)。

图2:蓝色为推理RL方法,红色为智能体RL方法,紫色为多智能体。虚线箭头表示从细粒度推理方法到粗粒度环境感知方法的演化趋势

说到底,智能体RL引入了6个推理RL不存在(或不严重)的挑战:

- 随机环境转移——调API可能超时,网页可能A/B测试,MC展开要重新执行环境交互,太贵了

- 部分可观察性——POMDP,你看到的不是完整状态,决策错误和信息缺失难以区分

- 极长视野——100K到1M tokens,方差随T线性增长

- 异构动作类型——选工具、写代码、格式化输出,重要性天差地别,但episode-level信用一视同仁

- 中间状态不可验证——数学题每步能检查,但"搜Python爬虫教程"这个动作好不好?搜完才知道

- 分岔点问题——少数关键决策决定成败,但episode-level信用对其视而不见

这6个挑战不是简单加码,而是让推理RL的方法论基础(确定性转移、可验证步骤、单轮生成)全部失效。

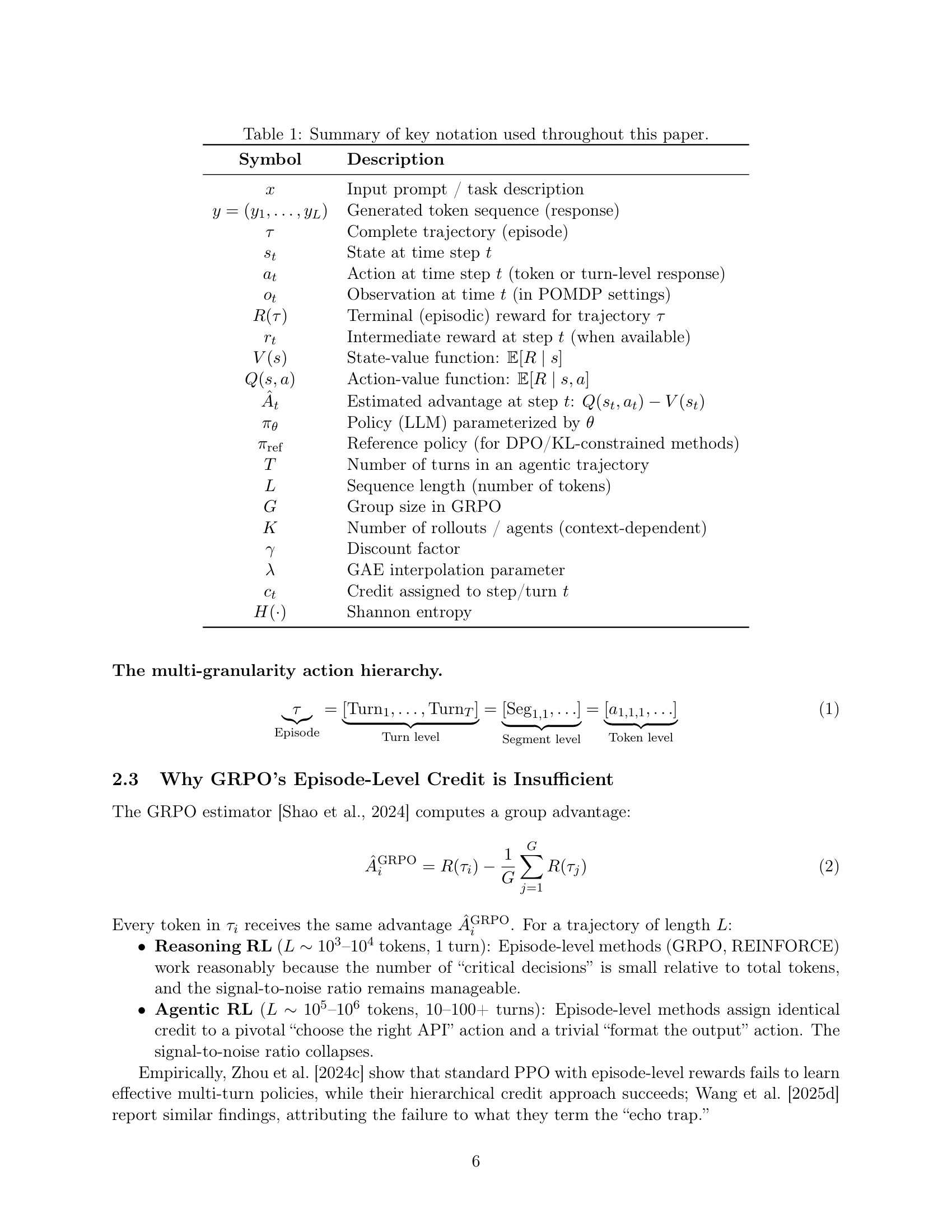

图3:按设置(推理/智能体/多智能体)和方法家族组织的层级分类,步骤/轮次级是最密集的区域

推理RL的信用分配:三个层次走向成熟

Token级:MC展开的暴力美学

VinePPO(ICML 2025)的思路很直接:PPO的learned critic不准,那就不要critic了,直接在中间前缀处分叉K次续写,用MC估计token级价值 \(V(s_t) \approx \frac{1}{K}\sum_{k=1}^{K} R(\tau_t^{(k)})\)。无偏,但计算量是 \(\mathcal{O}(K \cdot L)\) 级别的前向传播。

说实话,VinePPO给我最大的启发不是方法本身,而是它证明了一件事:信用分配质量才是瓶颈,策略优化不是。PPO换一个更好的信用信号就能大幅涨点,说明PPO的critic网络在LLM这种高维动作空间里确实拉胯。

RED和T-REG走的是低成本路线:RED探测现成reward model的隐层表征做线性回归,零额外RL训练实现token级重分配;T-REG对比模型生成正确和错误解的token级对数概率差异,自监督生成奖励信号。精度不如VinePPO,但成本极低。

From r to Q*从理论上证明了DPO隐式学习了token级Q函数:

这个结论挺漂亮:信用分配可能是alignment训练的"免费副产品"。

Segment级:语义切分的中间地带

Token级太细,step级又需要外部标注,segment级是一个自然的折中。

SPO在推理链的"切割点"(推理方式转换的位置)分段,每段计算MC优势。你想想看,解一道数学题,"设未知数"和"解方程"就是两个不同的segment——SPO让每个segment获得独立的信用信号,而不是一整条链共享一个reward。

TEMPO把推理结构泛化为树,叶节点用MC估计,内部节点用TD自举,不需要critic。这个树结构的设计挺巧妙:在分叉点(比如尝试不同解法),TEMPO同时探索多条路径,然后自底向上传递信用。叶节点的MC估计无偏,内部节点的TD自举降方差,两种估计各司其职。

SCAR把推理链当合作博弈,用Shapley值分配segment信用——理论上最优雅,计算上最昂贵。Shapley值是唯一同时满足效率性、对称性和零贡献者属性的分配方案,但在n个segment上需要评估 \(2^n\) 个联盟。SCAR用采样近似来降成本,不过计算开销依然是所有方法中最大的。

Step级:PRM的天下

这是推理CA最热闹的战场。PRM(Process Reward Model) 本身就是信用分配——给每个推理步骤打分,就是在做step级的信用分解。论文专门做了一个澄清:PRM文献和CA文献是同一个问题的两种视角。

PURE(ICML 2025)提出了一个重要的改进:标准PRM用"求和"形式 \(V(s_t) = \mathbb{E}[\sum_{t'\ge t} r_{t'}]\),容易被reward hacking;PURE改用"最小值"形式 \(V(s_t) = \mathbb{E}[\min_{t'\ge t} r_{t'}]\),让最弱步骤决定信用,堵住了模型用"安全"中间步骤刷分的漏洞。

SPRO的掩码步骤优势更直觉:移除某一步后看正确率下降多少,下降越多说明这步越关键。\(c_i = P(\text{correct}|\text{full}) - P(\text{correct}|\text{without step } i)\)。报告训练效率提升3.4倍。

CAPO让LLM当自己的评判器(Generative PRM),自给自足但存在自评偏差风险。HICRA区分了"规划token"和"执行token",对规划token集中信用——这个思路在智能体场景下会更有价值。说到这个,推理RL里区分规划和执行的需求还不那么强烈,但到了智能体场景,"选什么策略"和"怎么执行策略"的重要性差异就更明显了。

智能体RL的信用分配:全新战场

推理RL的三个隐含假设——确定性转移、单轮生成、可验证结果——在智能体场景下全部失效。所以你不能简单地把PRM搬过来用。让我把推理和智能体的CA差异对比摆出来:

| 维度 | 推理RL | 智能体RL |

|---|---|---|

| 环境转移 | 确定性 | 随机性(API超时、网页变化) |

| 可观察性 | 完全可见 | 部分可观察(POMDP) |

| 典型长度 | 1轮,0.5K-30K tokens | 10-100+轮,100K-1M tokens |

| 动作类型 | 同质(生成token) | 异质(工具、规划、格式化) |

| 中间验证 | 通常可行 | 几乎不可能 |

| 分岔点 | 中等频率 | 稀少但决定性 |

| CA难度 | ★★ | ★★★★★ |

这个对比说明了为什么推理CA的成熟方案不能直接迁移——每一个维度的变化都在给信用分配增加新的障碍。

轮次级PRM:适配不确定性的环境

AgentPRM用TD+GAE替代MC标记,因为MC需要重新执行环境交互来估计步骤正确性,这在智能体场景下太贵了(要启动沙箱、调真实API)。AgentPRM用TD自举的方式训练step-level critic,报告样本效率提升8倍。其实吧,这就是推理和智能体场景的一个核心分水岭:推理RL的确定性转移让MC展开几乎是免费的,但智能体RL的随机环境让MC展开的成本直接爆炸。

SWEET-RL(Meta/FAIR)的思路更巧妙:训练时我们有ground truth和完整轨迹,推理时没有——那就利用这个不对称性!训练一个能看"特权信息"的critic提供高质量轮次级奖励,actor端只看正常观测。这个设计优雅地绕过了中间状态不可验证的难题。

Turn-PPO(EACL 2026)把多轮交互重构为轮次级MDP,每个轮次当作一个宏动作,计算轮次级advantage。TARL用LLM法官提供轮次级评估,在 \(\tau\)-bench上比强RL基线任务通过率提升6%+。

后见之明与反事实:回头看才看得清

这是智能体CA最有意思的方向。2026年3月一周之内出现了三篇独立工作——HCAPO、C3、CCPO——都指向同一个思路:轨迹收集完了再回过头来看,哪个轮次真正重要。

HCAPO让LLM critic在知道完整轨迹结果的情况下,对每个轮次做回顾性评估,甚至生成反事实续写("如果这一轮做了不同选择会怎样")。关键洞察是:后见之明比前向估计信息更丰富——你能区分"碰巧走运"和"真正做对了"。

C3用留一法框架形式化:\(c_t = R(\tau) - R(\tau_{\setminus t})\),即去掉第t轮后的反事实结果。环境重新执行太贵,就用LLM估计反事实结果。

CCPO更形式化,用结构因果模型(SCM)建模轨迹,把轮次信用定义为平均处理效应(ATE)。这是因果推断视角的信用分配,理论保证更强。

三篇论文一周内出现,这个时间点不是巧合——社区集体意识到了一件事:在智能体RL中,向后看比向前猜更靠谱。

回到这几个方法的共同逻辑:智能体的环境太不确定,前向预测不准,但轨迹收集完之后回头看,你拥有了完整信息。HCAPO用"后见之明"区分"碰巧成功"和"真正做对",C3用留一法估算每轮的反事实贡献,CCPO甚至引入了因果推断的数学框架。这三条路殊途同归,都在回答同一个问题:事后看来,这一轮到底重不重要?

无评判器的步骤级方法

GiGPO(NeurIPS 2025)是GRPO的优雅推广:外层按标准GRPO做episode-level群组比较,内层按"锚定状态分组"做step-level比较——共享相似前缀的步骤分为一组,组内计算相对优势。不需要critic,在ALFWorld上比GRPO提升12%,WebShop上提升9%。

CARL(NeurIPS 2025)的思路极其简洁:大部分动作根本不值得分配信用。用动作熵 \(H(\pi(\cdot|s_t))\) 识别分岔点——高熵意味着模型不确定,选择重要;低熵意味着模型很确定,怎么选都差不多。只在最高熵的少数动作上做RL更新,减少72%的梯度更新,性能不降。这个结果暗示了一个重要的方向:智能体CA的目标不应该是给每个动作完美分配信用,而是识别出那些真正重要的动作。

层次化方法

ArCHer(ICML 2024)是智能体多轮RL的开山之作:高层离策略critic学习轮次级Q函数,低层在策略actor优化token级策略。双层解耦直接对应了智能体CA的双重层次——哪一轮重要,那一轮里哪些token重要。ArCHer也是第一个正式认识到多轮LLM RL需要根本不同于单轮推理的信用分配方法的工作。

PilotRL把层次推到三级:规划级→步骤级→token级,信用从粗到细逐级传递。这种级联式设计适合那些先显式制定计划、再逐步执行的智能体——比如"第一步搜索相关文件,第二步理解代码结构,第三步实现修复"。

还有一个值得关注的思路:SPA-RL训练一个轻量MLP进度估计器,把中间状态映射为0到1的"进度分数",步骤信用就是进度增量 \(c_t = p_t - p_{t-1}\)。成本极低——一个小MLP相比LLM评判器几乎可以忽略,在大规模训练中这个FLOP差异很实在。

信息论方法

IGPO定义信息增益为信用:\(c_t = \log P(\text{success}|h_{1:t}) - \log P(\text{success}|h_{1:t-1})\)。一个轮次如果能大幅提升任务成功概率,就获得高信用。这个定义对搜索型智能体特别自然——每次搜索查询都"揭示"了新信息。

多智能体信用分配:新兴前沿

当多个LLM协作时,信用还要跨智能体分解。

SHARP把Shapley值推广到多智能体场景,报告比单智能体提升23.7%、比多智能体基线提升14.1%。MAPPA提供per-action粒度的过程奖励,在AIME上+5.0-17.5pp。Dr. MAS发现标准多智能体GRPO的global normalization会扭曲不同智能体的梯度尺度,改用per-agent归一化后+5.6%。

M-GRPO支持解耦训练,每个智能体独立更新。LLM-MCA用LLM当中心化critic,能理解语义层面的智能体贡献。QLLM更激进——让LLM直接生成信用分配函数的Python代码。

说实话,多智能体CA这块还处于很早期阶段,6篇论文各有各的benchmark,跨方法对比几乎不可能。但方向是明确的:随着多智能体系统在2026-2027年大规模部署,这会是一个重要的增长点。

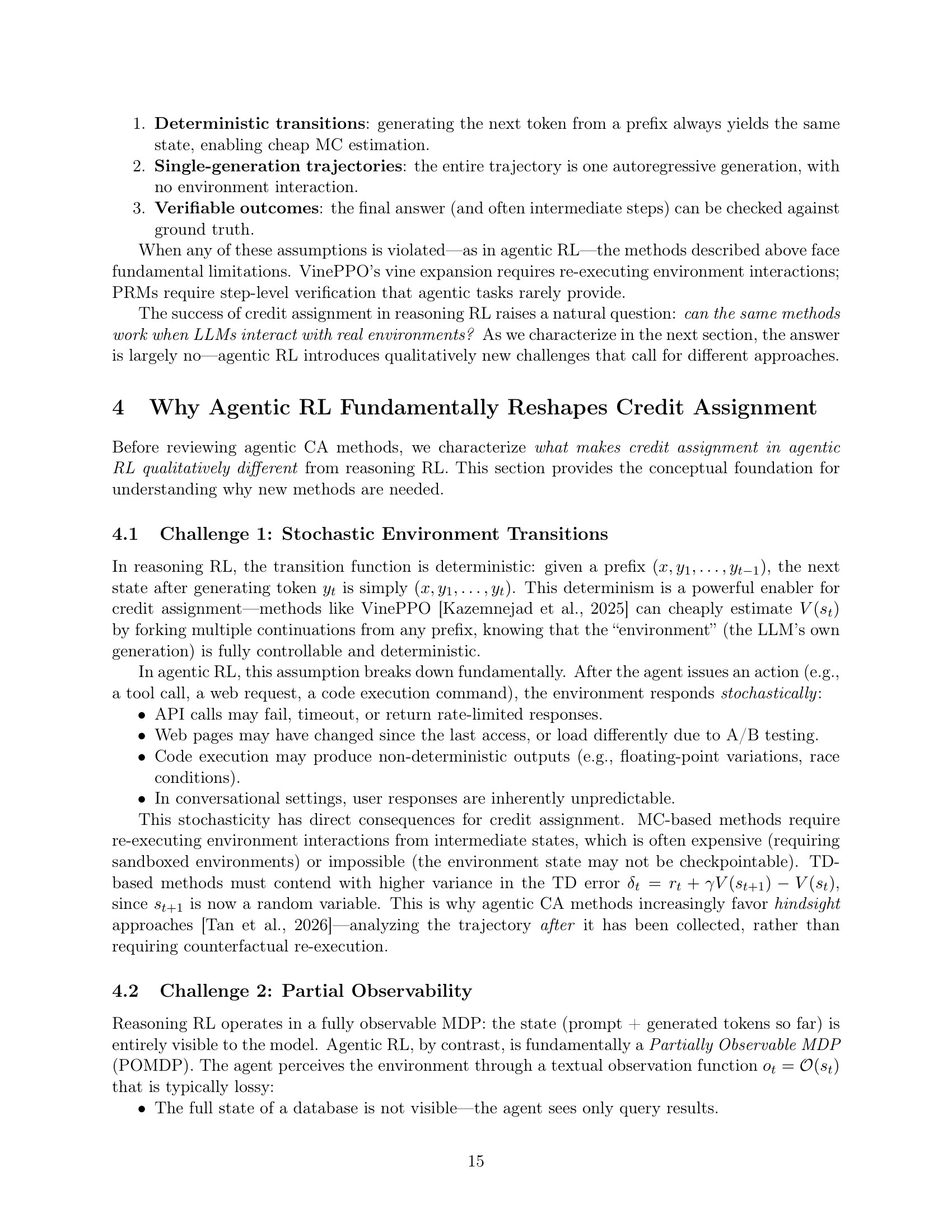

方法选型:一个决策树

图4:根据任务设置、CoT长度/回合数、算力预算等条件选择合适的CA方法

论文提供了一个实用的决策树,我简化如下:

| 场景 | 特征 | 推荐方法 |

|---|---|---|

| 数学推理 (GSM8K/MATH) | 短CoT,可验证 | GRPO, PURE, SPO, Spro |

| 竞赛数学 (AIME) | 长CoT (10K-30K) | VinePPO, HICRA, CAPO |

| 工具调用 (WebShop/ALFWorld) | 5-20轮,部分可验证 | GiGPO, AgentPRM, Turn-PPO |

| 网页导航 (WebArena) | 10-30轮,随机POMDP | SWEET-RL, HCAPO, IGPO |

| 软件工程 (SWE-bench) | 50-100+轮,不可验证 | CARL, HCAPO, C3/CCPO, ArCHer |

| 多智能体 | 跨智能体信用 | M-GRPO, SHARP, MAPPA |

| 算力受限 | 低GPU预算 | GRPO, CARL, iStar, GiGPO |

核心原则:推理场景看CoT长度选粒度,智能体场景看回合数和验证性选方法论。

关键实验数据

推理RL的量化对比:

| 方法 | 基座模型 | 基准 | 得分 | 基线 | 增益 |

|---|---|---|---|---|---|

| SPO | DeepSeek-R1-Distill-Qwen-1.5B | MATH-500 | 82.8% | GRPO 75.2% | +7.6 |

| SPO | RhoMath-1.1B | GSM8K | 56.7% | GRPO 45.7% | +11.0 |

| Spro | Eurus-2-7B-SFT | AMC | 31.9% | GRPO 23.6% | +8.3 |

| CAPO | Qwen2.5-7B | AIME'24 | 9.7% | GRPO 3.6% | +6.1 |

| HICRA | Qwen3-4B-Instruct | AIME'25 | 65.1% | GRPO 60.0% | +5.1 |

智能体RL的量化对比:

| 方法 | 基座模型 | 基准 | 得分 | 基线 | 增益 |

|---|---|---|---|---|---|

| GiGPO | Qwen2.5-7B-Instruct | ALFWorld | 90.2% | GRPO 77.6% | +12.6 |

| GiGPO | Qwen2.5-7B-Instruct | WebShop | 75.2% | GRPO 66.1% | +9.1 |

| CARL | 7B non-reasoning | HotpotQA (F1) | 51.9 | GRPO 47.0 | +4.9 |

| SWEET-RL | Llama-3.1-8B-Instruct | ColBench Backend | 40.4% | MT-DPO 34.4% | +6.0 |

| AgentPRM | Qwen2.5-3B | WebShop @\(8{\times}8\) | 76.0% | ORM 57.0% | +19.0 |

有个有意思的模式:智能体场景下CA方法的增益均值(+8.5)高于推理场景(+6.0)。这和理论预期一致——轨迹越长,episode-level信用退化越严重,精细CA的边际收益越大。不过要注意,这个比较受基座模型和benchmark差异的影响,只能当做粗略的趋势验证。

我的判断

这篇综述最大的价值不是47种方法的罗列,而是"推理→智能体"这个转变下信用分配问题的系统性重定义。

几个关键判断:

-

推理CA已经进入收获期。PRM(特别是PURE的最小值信用)和无评判器方法(GRPO家族的群组比较)形成了成熟的技术栈。如果你在做数学推理,直接用GRPO+PRM就够用了,不需要折腾VinePPO这种计算量翻几倍的方法。

-

智能体CA是真正的蓝海。事后反事实分析(HCAPO/C3/CCPO)在2026年3月的一周内三篇论文同时出现,这个收敛速度说明社区找到了一个真正的方向。但说实话,目前这些方法的实验规模都偏小——SWEET-RL在ColBench上只涨了6个点,HCAPO/C3/CCPO甚至没有公开的标准化benchmark对比。距离工程落地还有距离。

-

CARL的"稀疏信用"理念被低估了。72%的梯度更新砍掉还不掉点,这说明智能体轨迹中大部分动作的信用接近零。与其花大力气给每个动作精确分配信用,不如先找到那些真正重要的分岔点。这个思路可能会成为智能体CA的主流范式。

-

一个明显的gap:没有任何方法同时解决了6个智能体挑战。论文的挑战-方法对照表显示,即使是最好的方法也只直接解决了1-2个挑战。这意味着组合多种CA方法可能是未来的方向——比如CARL识别分岔点 + HCAPO做反事实分析。

-

评估碎片化是最大障碍。推理RL有GSM8K/MATH/AIME共享的benchmark体系,智能体RL几乎每篇论文用不同的benchmark。没有可比性,就无法判断哪个方法真正更好。论文提出的benchmark协议规范是一个好的开始,但需要社区采纳才有意义。

-

CA × 探索的交叉几乎空白。信用信号理论上可以指导探索——优先探索信用不确定的状态。IGPO用信息论方式定义信用,朝这个方向走了一步,但目前没有方法显式地用CA不确定性驱动探索。这是一个被忽略的机会。

如果你在做智能体RL训练,我的建议是:先试GiGPO(零额外模型、低成本、在短-中等长度任务上效果显著),长轨迹再上CARL或HCAPO。推理场景直接GRPO+PURE/SPRO,不用过度设计。有一个计算效率的trade-off值得注意:投入更多计算在更好的CA上(比如VinePPO的vine展开),可以通过减少所需rollout数来回收——"更少轨迹但信用更精" vs "更多轨迹但信用更粗",这个最优分配目前还是个开放问题。

觉得有启发的话,欢迎点赞、在看、转发。跟进最新AI前沿,关注我